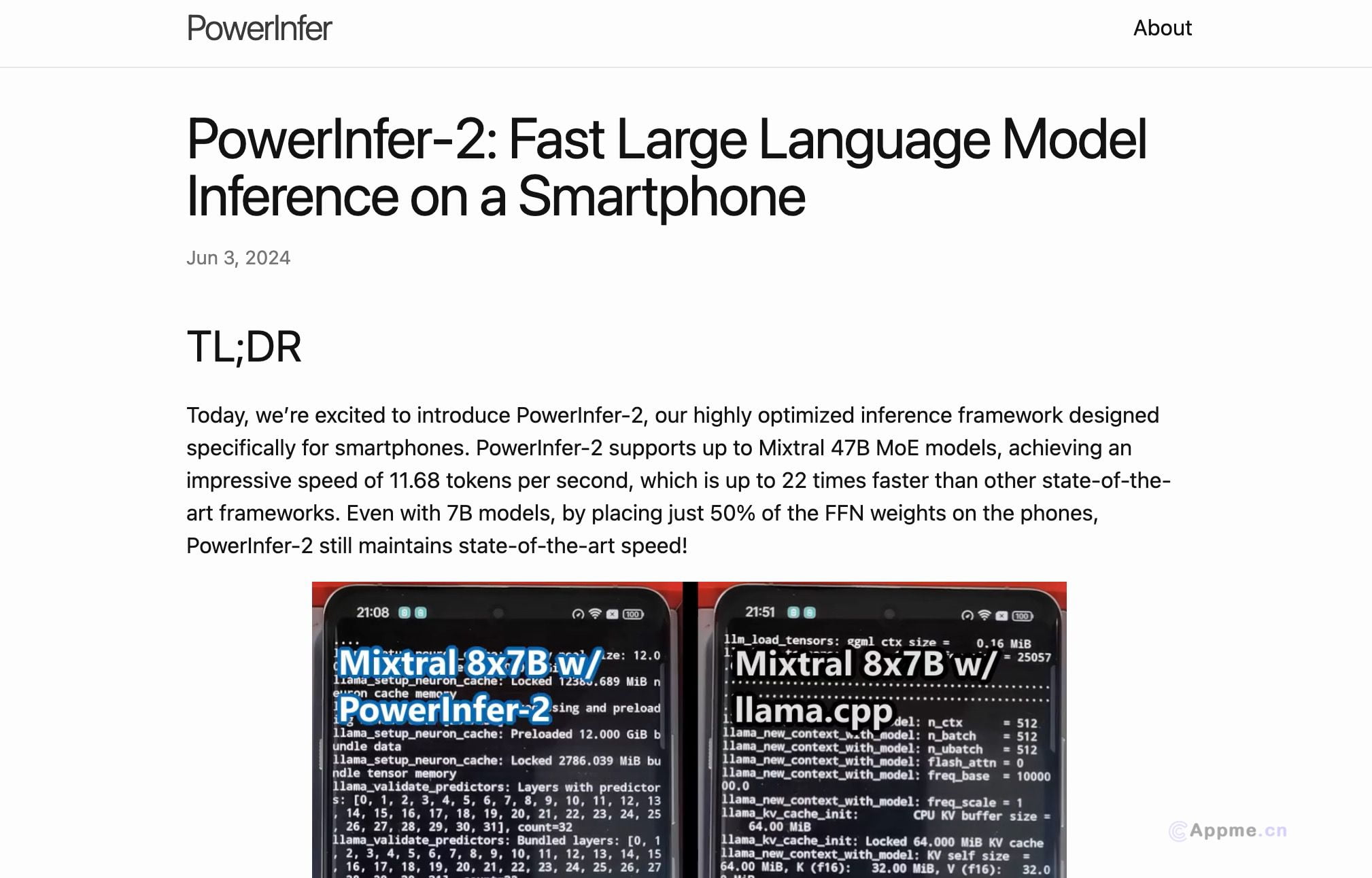

PowerInfer-2是一款为智能手机优化的高性能推理框架,支持高达47B参数的MoE模型,实现每秒11.68个token的推理速度,比其他框架快22倍。它通过异构计算和I/O-Compute流水线技术,显著减少内存使用并提高推理速度。该框架适用于需要在移动设备上部署大型模型的场景,特别适合移动应用开发者、企业和研究机构。PowerInfer-2的主要优势在于其高速推理能力、内存优化和数据隐私保护。它能够帮助用户在智能手机上实现个性化推荐、客户服务自动化和实时语言翻译等功能,同时确保数据隐私和应用性能。对于追求高性能移动AI应用的开发者和企业来说,PowerInfer-2提供了一个强大而高效的解决方案,使他们能够在移动设备上充分发挥大型语言模型的潜力。