对话

对话类AI工具是人工智能领域的重要分支,主要用于实现人机自然语言交互。这类工具涵盖了聊天机器人、智能客服、虚拟助手等多种应用形态,核心功能是理解用户输入并提供相应回复。其主要优势在于全天候可用、反应迅速、知识面广。

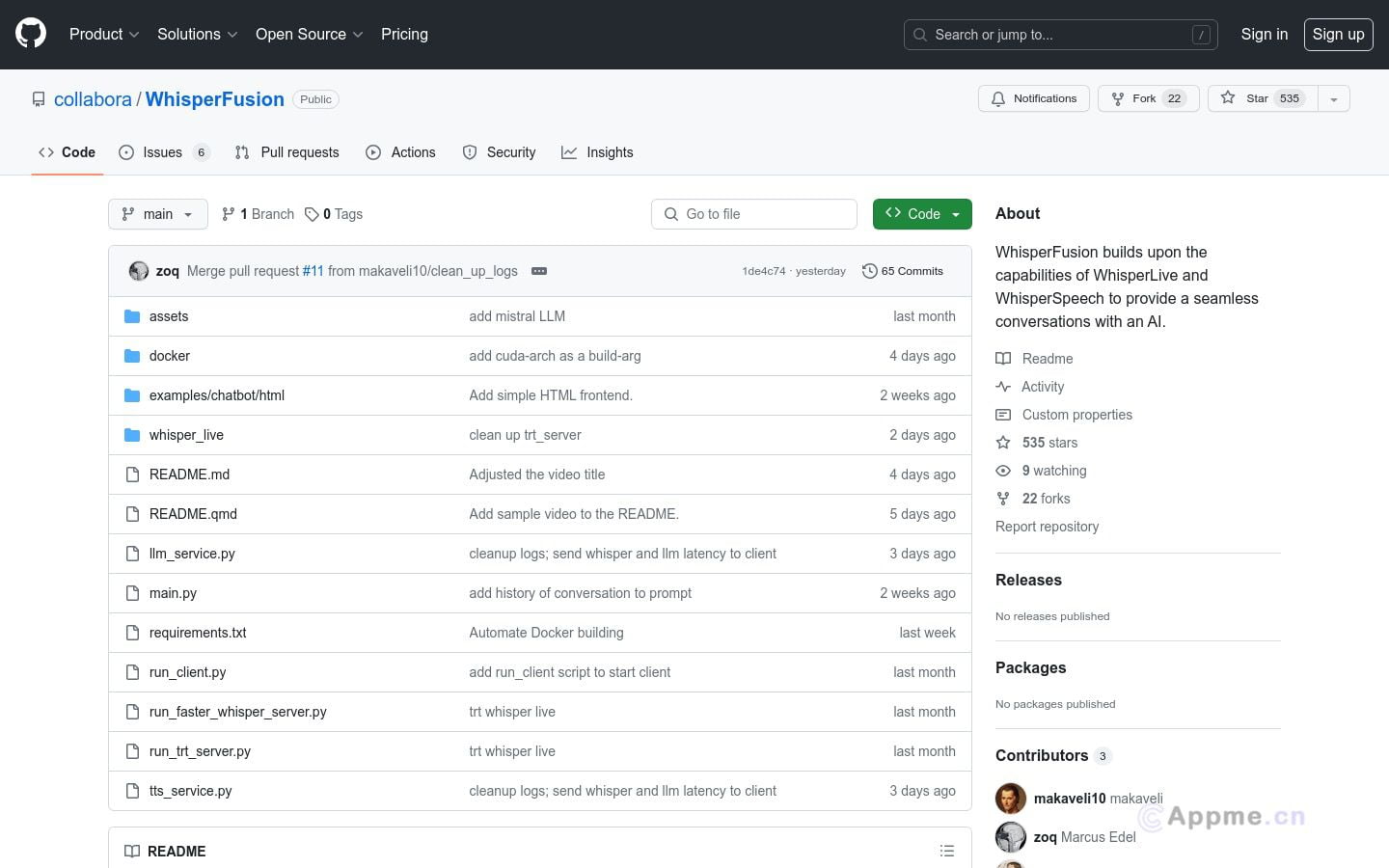

代表性技术包括自然语言处理(NLP)和深度学习。知名工具如OpenAI的ChatGPT和Google的LaMDA,展现了大型语言模型的强大能力。这些系统能够进行上下文理解、多轮对话、情感分析等复杂任务。

当前,对话AI正朝着多模态交互、个性化定制、知识图谱集成等方向发展。未来有望在教育、医疗、金融等领域发挥更大作用,推动人机协作迈向新高度。随着技术进步,对话系统将更加智能、自然,为用户提供更优质的交互体验。