多任务学习

多任务学习是人工智能领域的一个重要分支,旨在开发能够同时处理多个相关任务的AI模型。这类工具通过共享表示和参数,实现知识迁移和协同学习,从而提高模型的泛化能力和效率。典型应用包括自然语言处理、计算机视觉和语音识别等多模态任务。

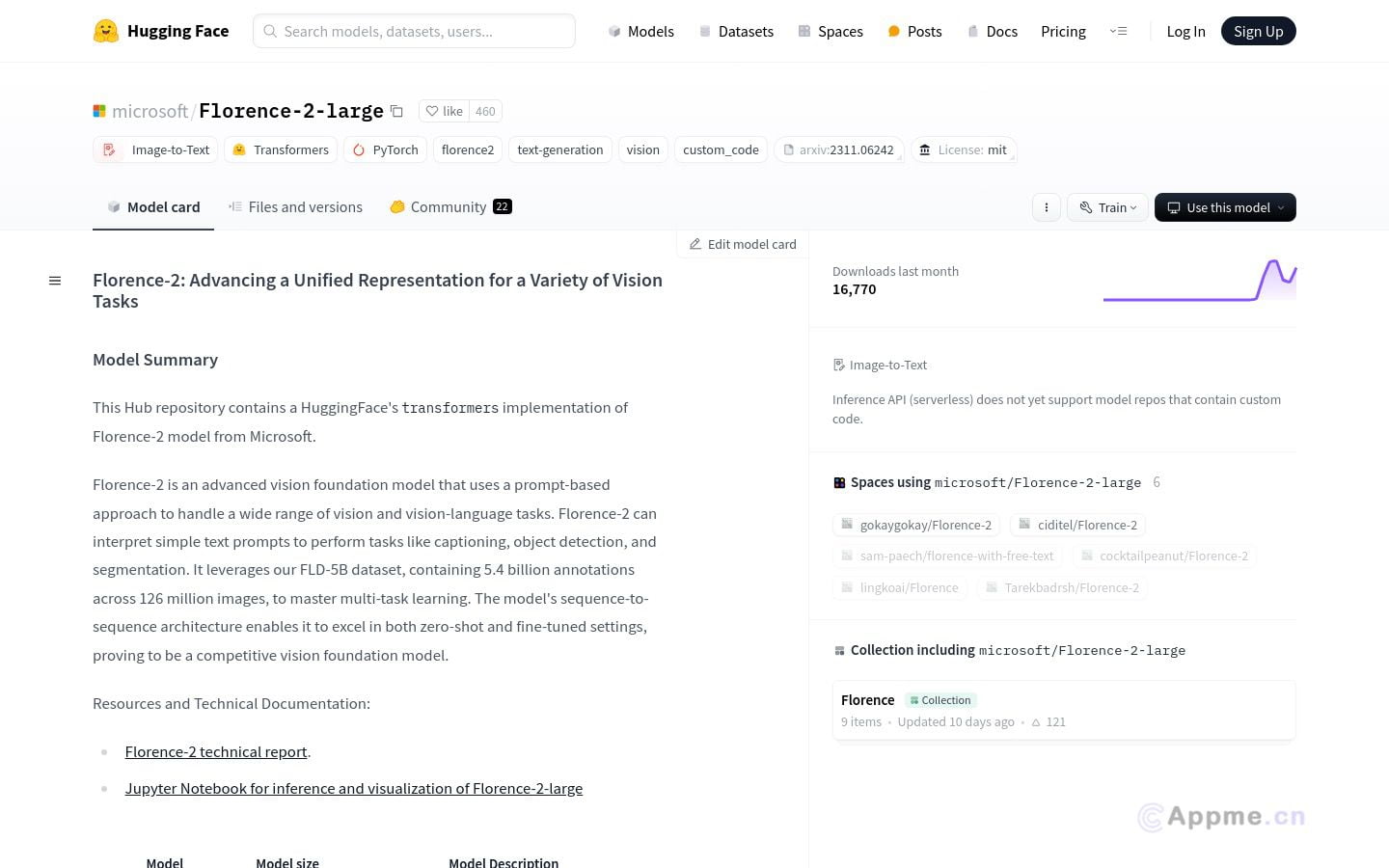

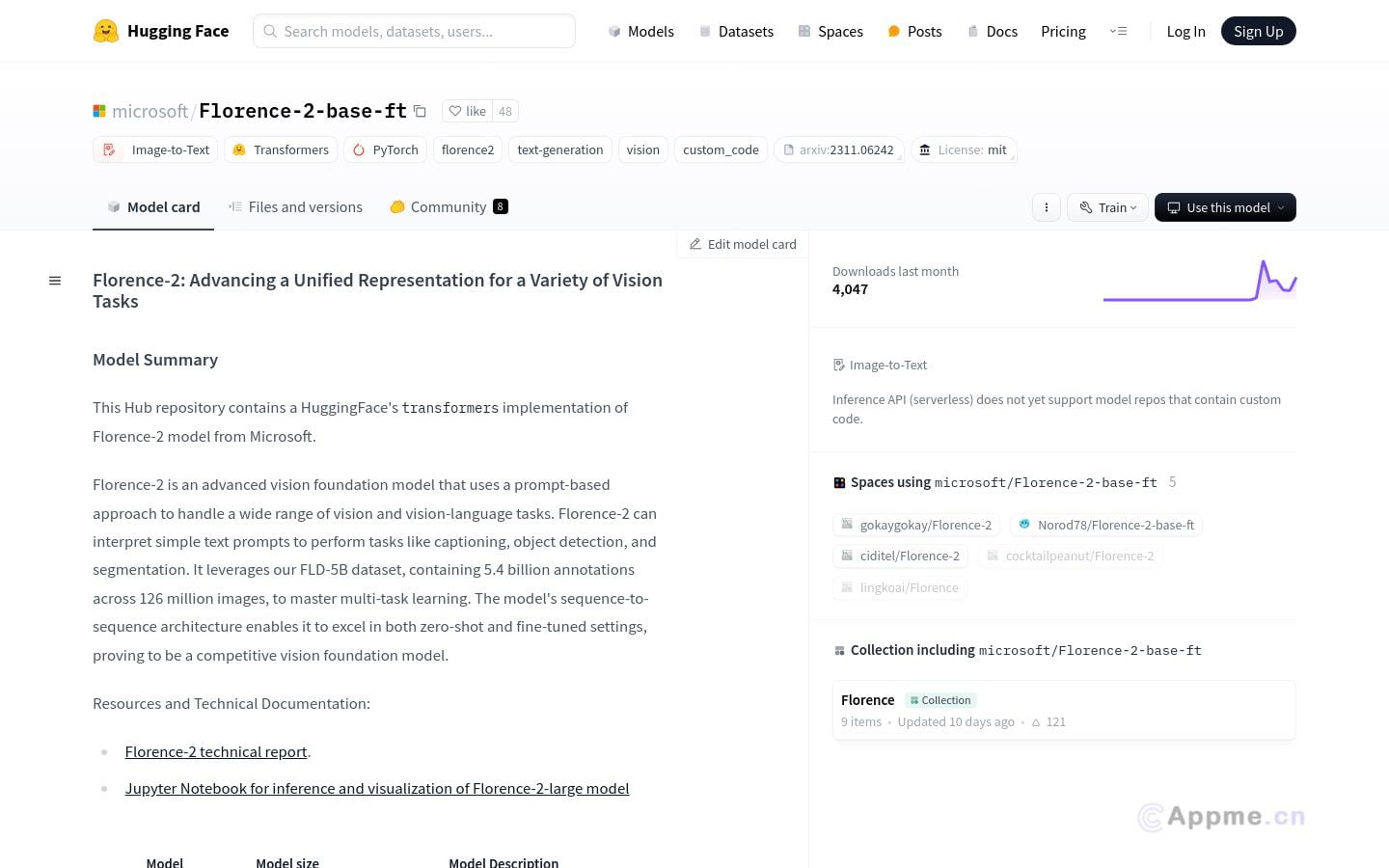

代表性技术如多任务深度神经网络(MT-DNN)和软参数共享等,能够灵活平衡任务间的相关性和差异性。Google的BERT和OpenAI的GPT等大规模预训练模型也广泛应用多任务学习思想。

这类工具的主要优势在于提高数据利用效率、减少过拟合风险,以及在资源受限情况下实现性能优化。随着跨模态和跨域应用需求增加,多任务学习正朝着更大规模、更高效的方向发展,有望在通用人工智能领域发挥关键作用。