预训练模型

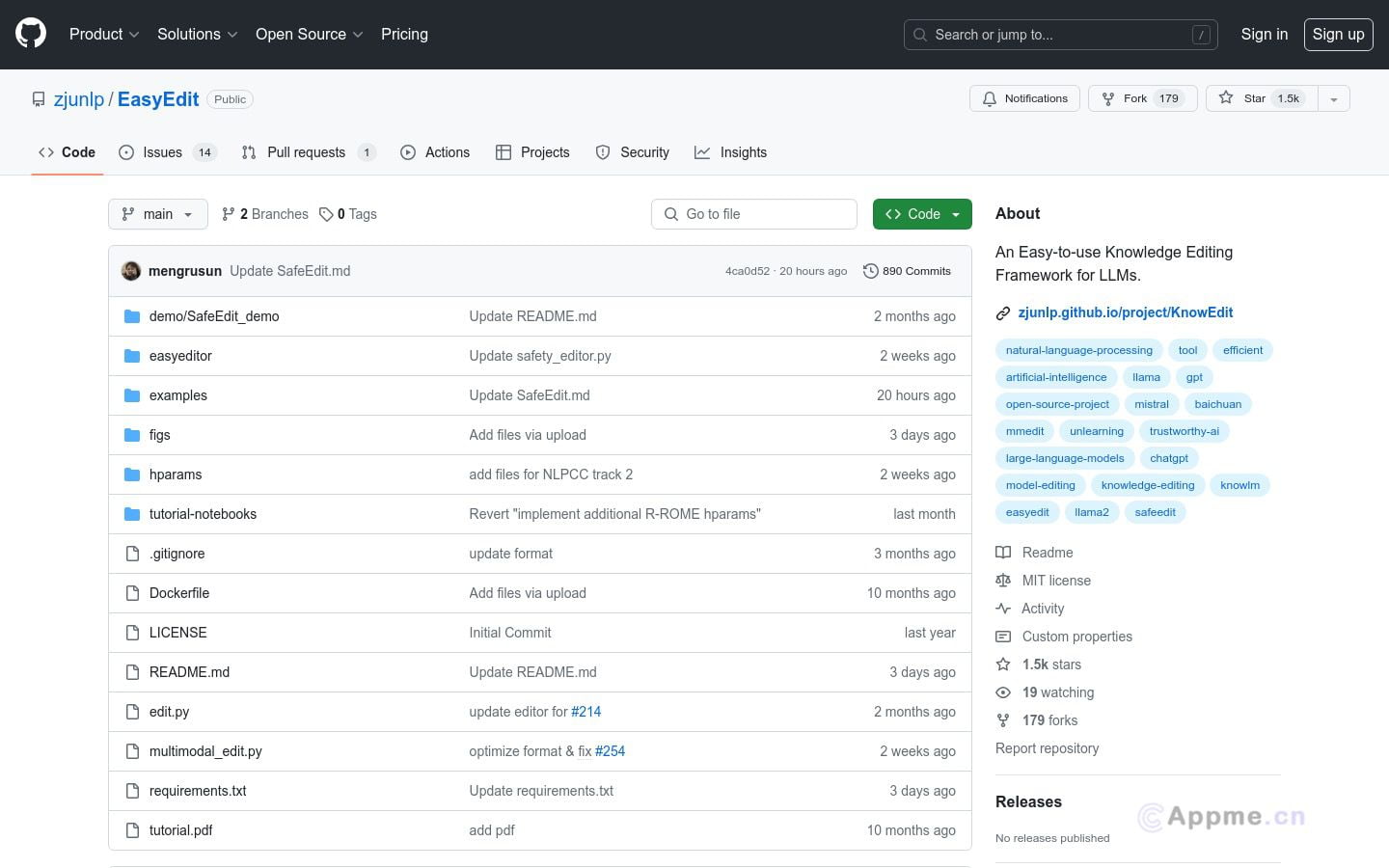

预训练模型是人工智能领域的重要基础设施,广泛应用于自然语言处理、计算机视觉等多个方向。这类模型通过大规模数据预训练,可以学习到通用的特征表示,为下游任务提供强大的迁移学习能力。

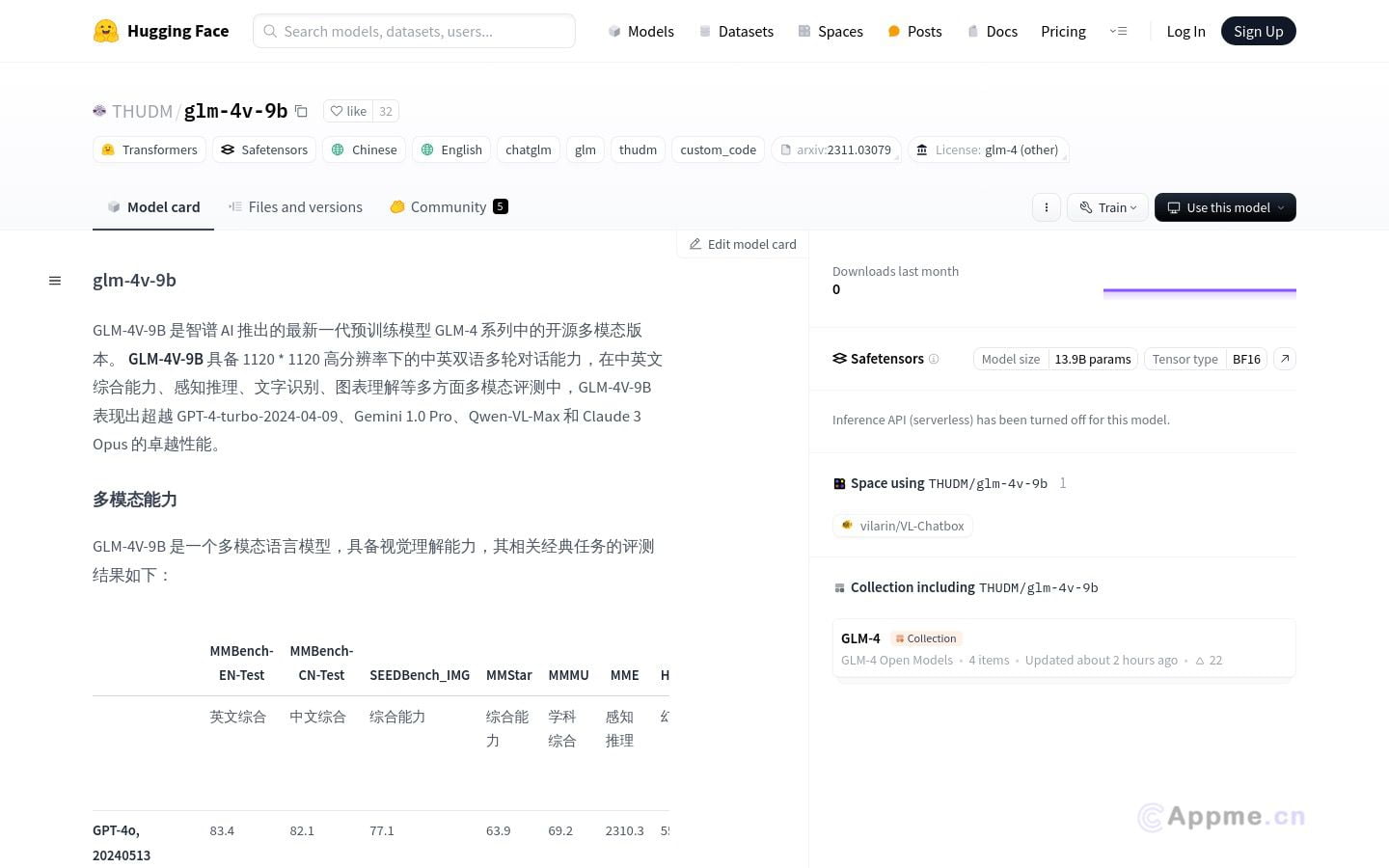

代表性技术包括BERT、GPT系列等Transformer架构模型,以及在计算机视觉领域的ResNet等卷积神经网络模型。这些预训练模型具有参数规模大、训练成本高、泛化能力强等特点,可显著提升各类AI任务的性能。

预训练模型的核心优势在于其强大的特征提取和表示学习能力,能够快速适应不同的下游任务,大幅降低模型开发门槛。目前,预训练模型正向多模态、跨语言等方向拓展,未来有望成为通用人工智能的重要基石,推动AI技术在更多领域实现突破性应用。