文本到图像

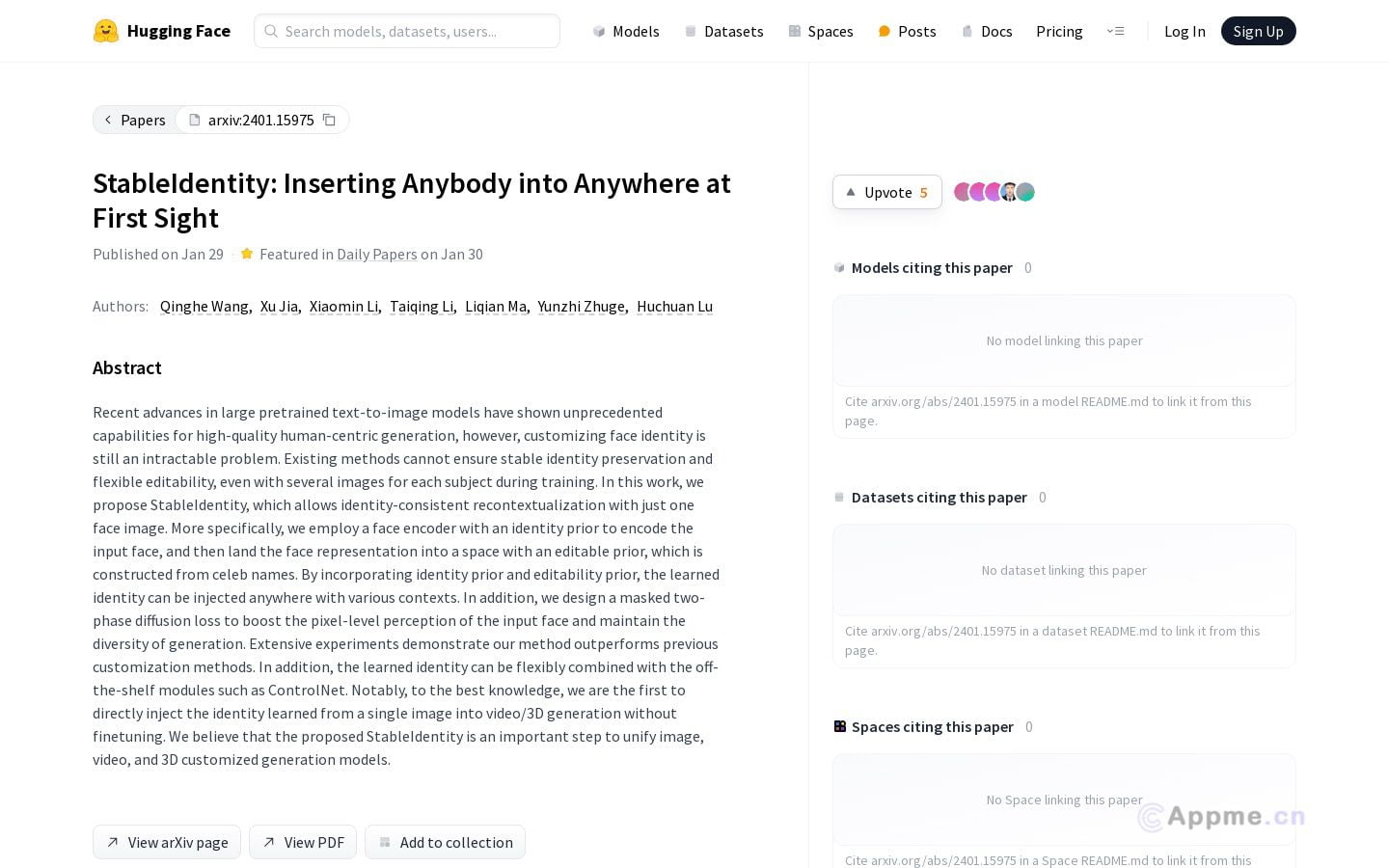

Ai网站最新工具StableIdentity,StableIdentity是一个基于大型预训练文本到图像模型的最新进展,能够实现高质量的以人为中心的生成。与现有方法不同的是,StableIdentity能够确保稳定的身份保留和灵活的可编辑性,即使在训练过程中只使用了每个主体的一张面部图像。它利用面部编码器和身份先验对输入的面部进行编码,然后将面部表示投射到一个可编辑的先验空间中。通过结合身份先验和可编辑性先验,学习到的身份可以在各种上下文中注入。此外,StableIdentity还设计了一个掩蔽的两阶段扩散损失,以提升对输入面部的像素级感知,并保持生成的多样性。大量实验证明,StableIdentity的性能优于以往的定制方法。学习到的身份还可以灵活地与ControlNet等现成模块结合使用。值得注意的是,我们是首个能够直接将从单张图像学习到的身份注入到视频/3D生成中而无需微调的方法。我们相信,StableIdentity是统一图像、视频和3D定制生成模型的重要一步。

文本到图像AI工具是一类能将文字描述转化为视觉图像的先进技术。这些工具利用深度学习和生成对抗网络(GAN)等算法,从文本输入中理解语义信息,并生成相应的高质量图像。它们在创意设计、内容创作、教育培训等领域有广泛应用。

代表性工具包括DALL-E 2和Midjourney,能够生成风格多样、细节丰富的图像。这类工具的核心优势在于快速将抽象概念可视化,大幅提升创作效率。它们支持多种艺术风格和图像类型,如写实照片、插画、3D渲染等。

文本到图像技术正在不断进步,未来有望实现更精准的文本理解和图像生成。随着模型规模扩大和训练数据增加,生成图像的质量和多样性将进一步提升。这为视觉内容创作和人机交互带来了革命性的可能。