transformer

Transformer是一种革命性的深度学习架构,广泛应用于自然语言处理、计算机视觉等领域的AI工具中。这类工具基于自注意力机制,能够高效处理序列数据,在机器翻译、文本生成、图像识别等任务中表现卓越。

代表性模型如BERT和GPT系列在各种NLP任务中取得了突破性进展。Transformer的优势在于其并行计算能力强,可以捕捉长距离依赖关系,且具有良好的可扩展性。

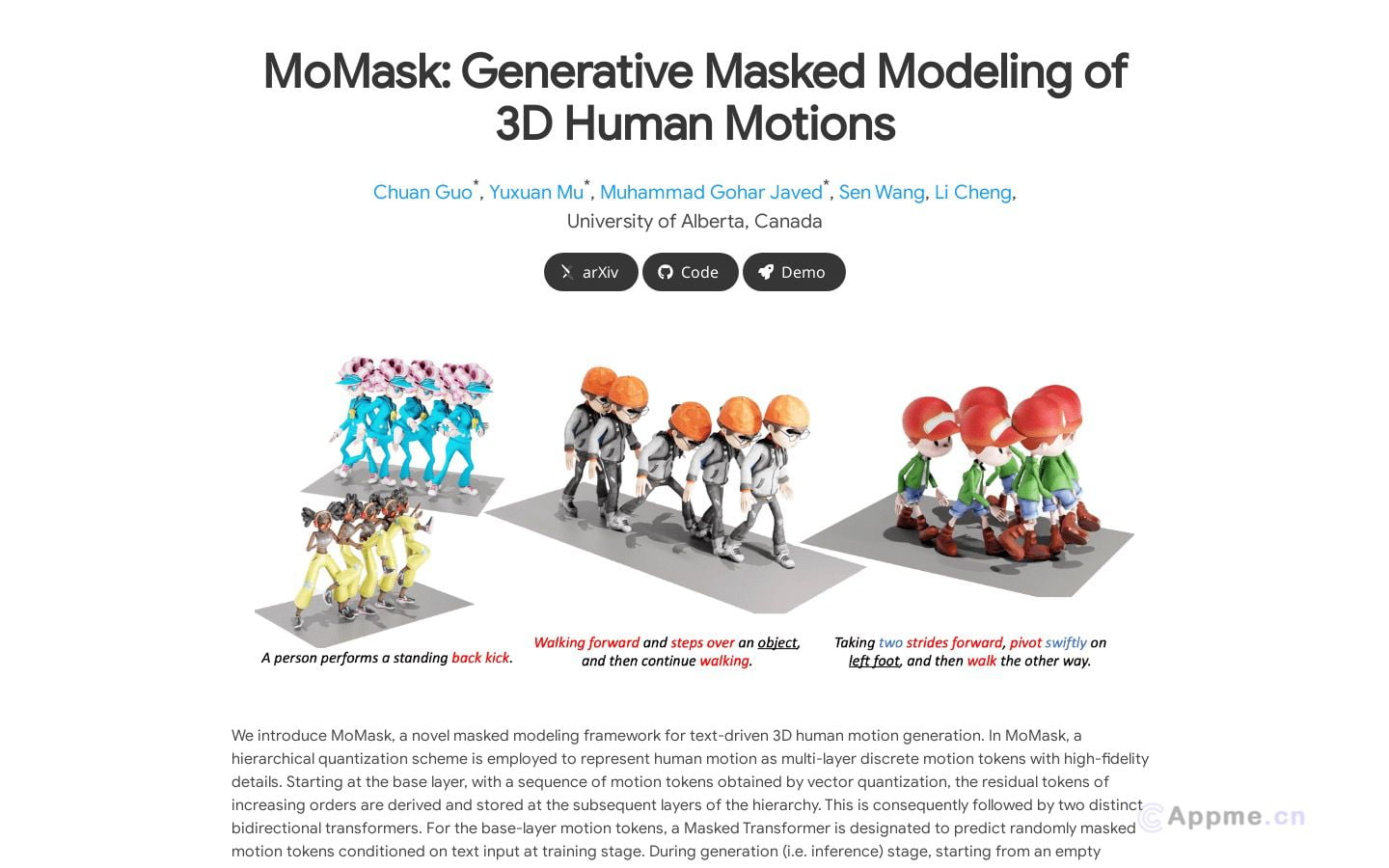

目前,基于Transformer的预训练模型和迁移学习方法正快速发展,如多模态Transformer等新兴技术不断涌现。这些工具在语言理解、知识图谱构建、跨模态任务等方面展现出巨大潜力,有望在智能对话、内容生成、视觉问答等更多场景中发挥重要作用。未来,Transformer有望继续推动AI技术向更智能、更通用的方向发展。