视觉

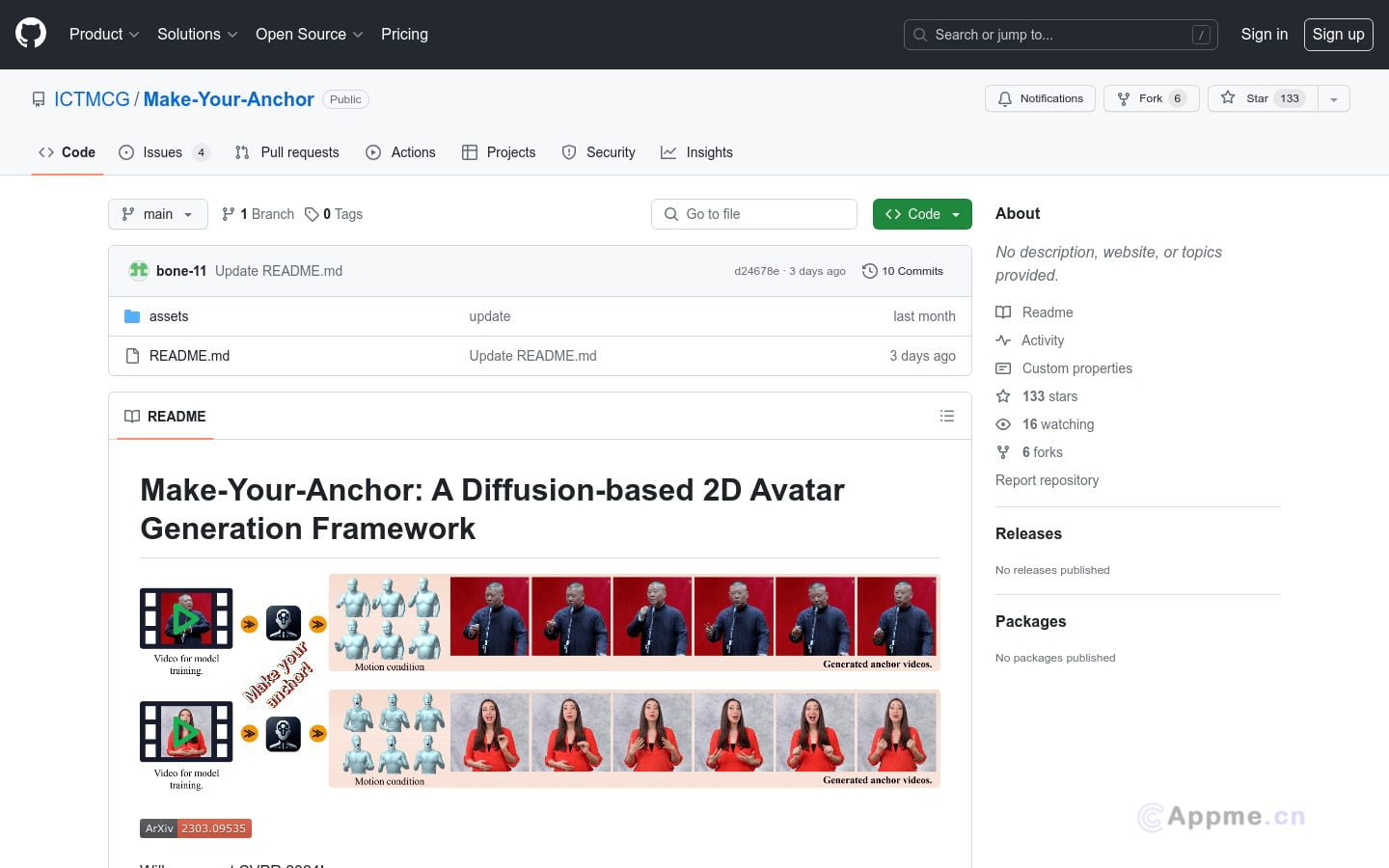

Ai模型最新工具Make-Your-Anchor,Make-Your-Anchor是一个基于扩散模型的2D虚拟形象生成框架。它只需一段1分钟左右的视频素材就可以自动生成具有精确上身和手部动作的主播风格视频。该系统采用了一种结构引导的扩散模型来将3D网格状态渲染成人物外观。通过两阶段训练策略,有效地将运动与特定外观相绑定。为了生成任意长度的时序视频,将frame-wise扩散模型的2D U-Net扩展到3D形式,并提出简单有效的批重叠时序去噪模块,从而突破推理时的视频长度限制。最后,引入了一种基于特定身份的面部增强模块,提高输出视频中面部区域的视觉质量。实验表明,该系统在视觉质量、时序一致性和身份保真度方面均优于现有技术。

视觉AI工具是一类专门处理和分析图像、视频等视觉数据的人工智能应用。这些工具涵盖了图像识别、物体检测、人脸识别、图像生成等多个领域,能够在安防监控、医疗诊断、自动驾驶等场景中发挥重要作用。

视觉AI的核心优势在于其强大的模式识别和特征提取能力,可以快速准确地处理海量视觉信息。代表性技术包括卷积神经网络(CNN)和生成对抗网络(GAN)。其中,计算机视觉领域的YOLO算法和图像生成领域的Stable Diffusion备受关注。

随着深度学习技术的进步,视觉AI正朝着多模态融合、低资源学习、可解释AI等方向发展。未来,视觉AI有望在增强现实、智能制造、内容创作等领域带来更多突破性应用,为人类视觉感知和创造能力带来质的飞跃。