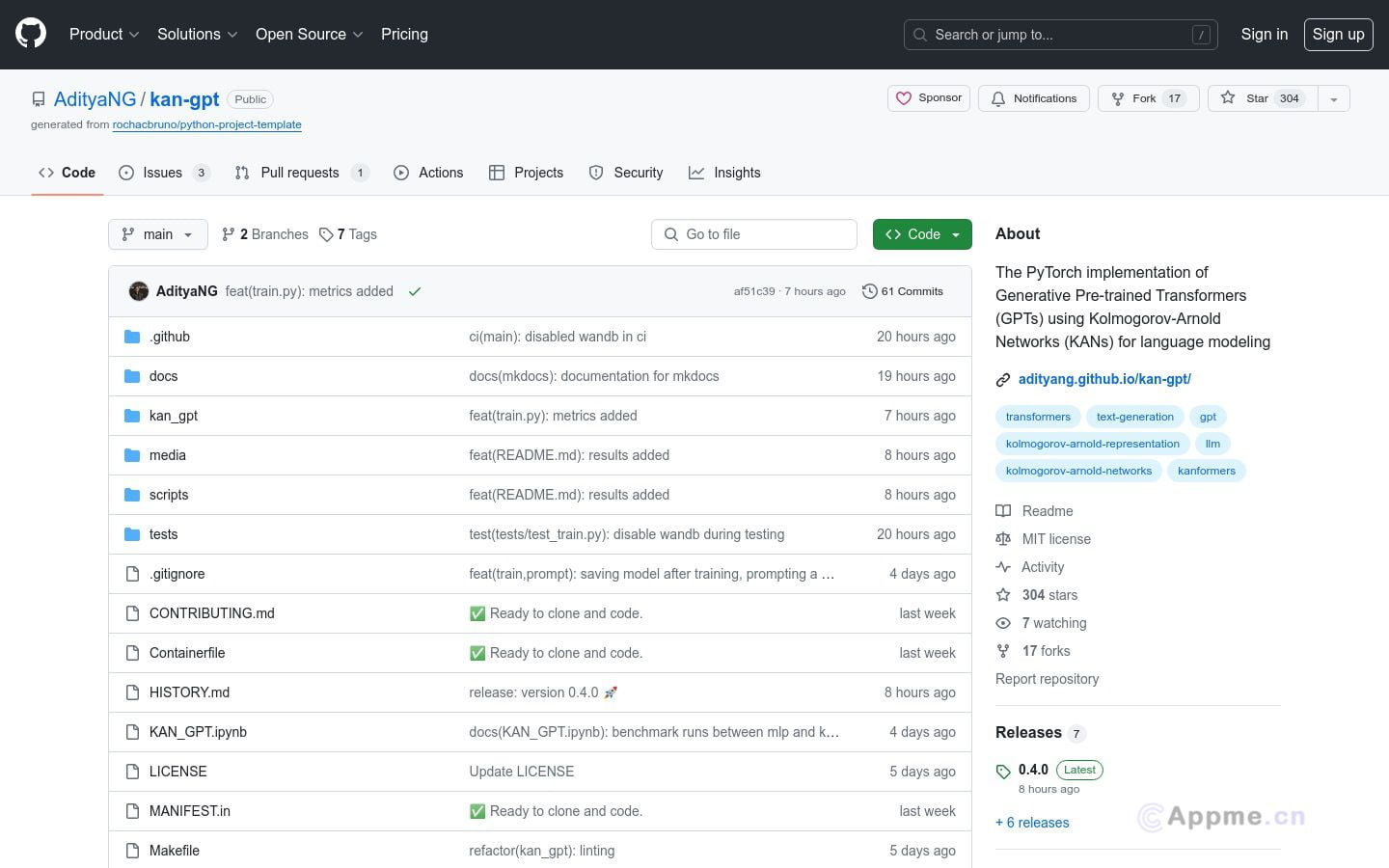

kan-gpt是一个基于PyTorch的生成式预训练转换器(GPT)实现,利用Kolmogorov-Arnold网络(KAN)进行语言建模。该工具在文本生成任务中表现出色,尤其擅长处理长距离依赖关系。kan-gpt支持从PyPI安装,提供使用示例和开发指南,允许自定义模型配置,集成了GPT2Tokenizer便于文本编码解码。它适用于研究人员、开发者和数据科学家,可用于语言模型研究、文本分析和生成任务。教育机构也可将其作为教学工具。kan-gpt为自然语言处理领域提供了新的模型架构,有助于提升语言模型性能,可应用于文章摘要生成、对话系统开发和内容推荐等场景,为用户带来更高效的文本处理和生成能力。