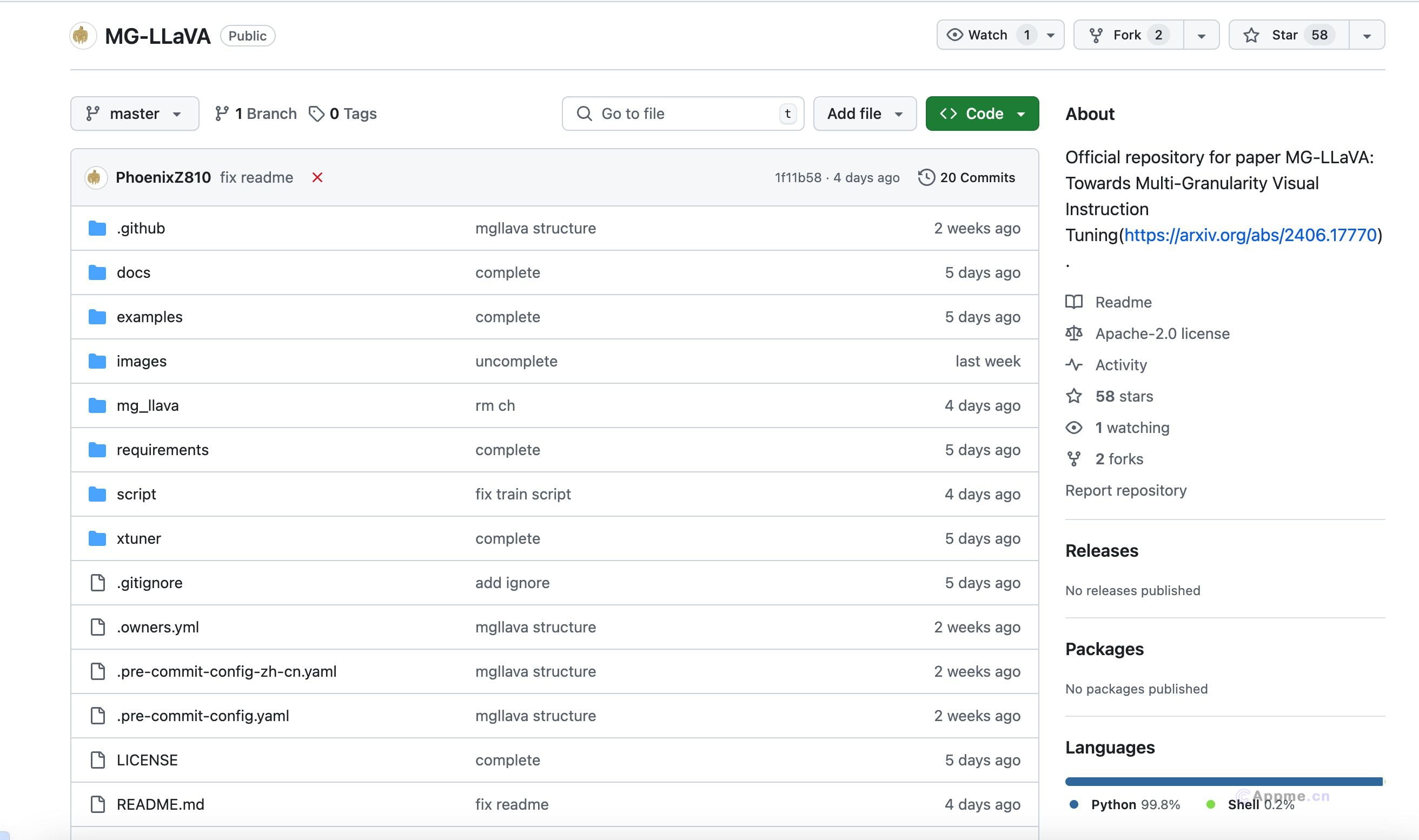

MG-LLaVA是一款先进的多模态机器学习语言模型,专注于增强视觉处理能力。它通过整合多粒度视觉流程,包括低分辨率、高分辨率和对象中心特征,显著提升了图像识别和理解能力。该模型采用创新的Conv-Gate融合网络和高分辨率视觉编码器,实现了细节捕捉和特征融合。MG-LLaVA仅使用公开多模态数据进行指令调优训练,展现出优秀的泛化能力和感知技能。它主要面向机器学习研究者和开发者,特别适合需要处理大量视觉和文本数据的专业人士。MG-LLaVA为用户提供了强大的工具,可用于多模态任务研究、社交媒体分析和视觉搜索优化等领域,帮助用户提升模型性能,实现更精准的图像识别和文本理解。