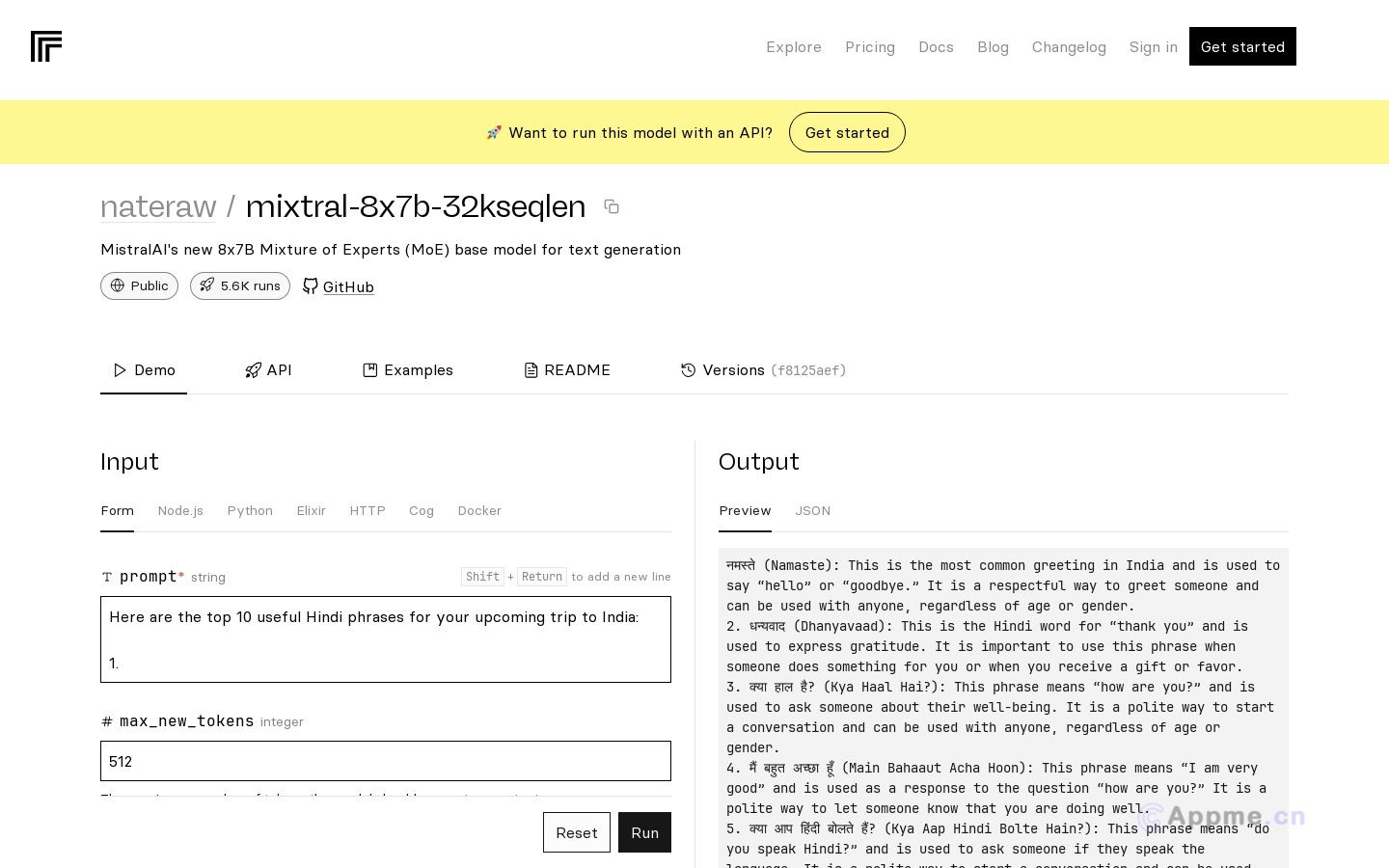

MoE 8x7B是MistralAI推出的一款先进的混合专家基础模型,专门用于高质量文本生成。该模型采用创新的混合专家架构,能够在各种文本生成任务中表现出色,包括撰写文章、生成对话、创作摘要等。其核心优势在于生成文本的质量高,适用范围广,可满足多样化的文本需求。

这款模型特别适合需要大量高质量文本内容的用户群体,如内容创作者、营销人员、研究人员等。它能够显著提高文本生成的效率和质量,为用户节省时间和精力。MoE 8x7B的定价灵活,根据实际使用情况计费,让用户可以根据需求选择合适的使用方案。

通过使用MoE 8x7B,用户可以快速获得高质量的文本输出,提升工作效率,同时保证内容的多样性和创新性。这款工具为解决各种文本生成难题提供了强有力的支持,是提升文本创作能力的理想选择。