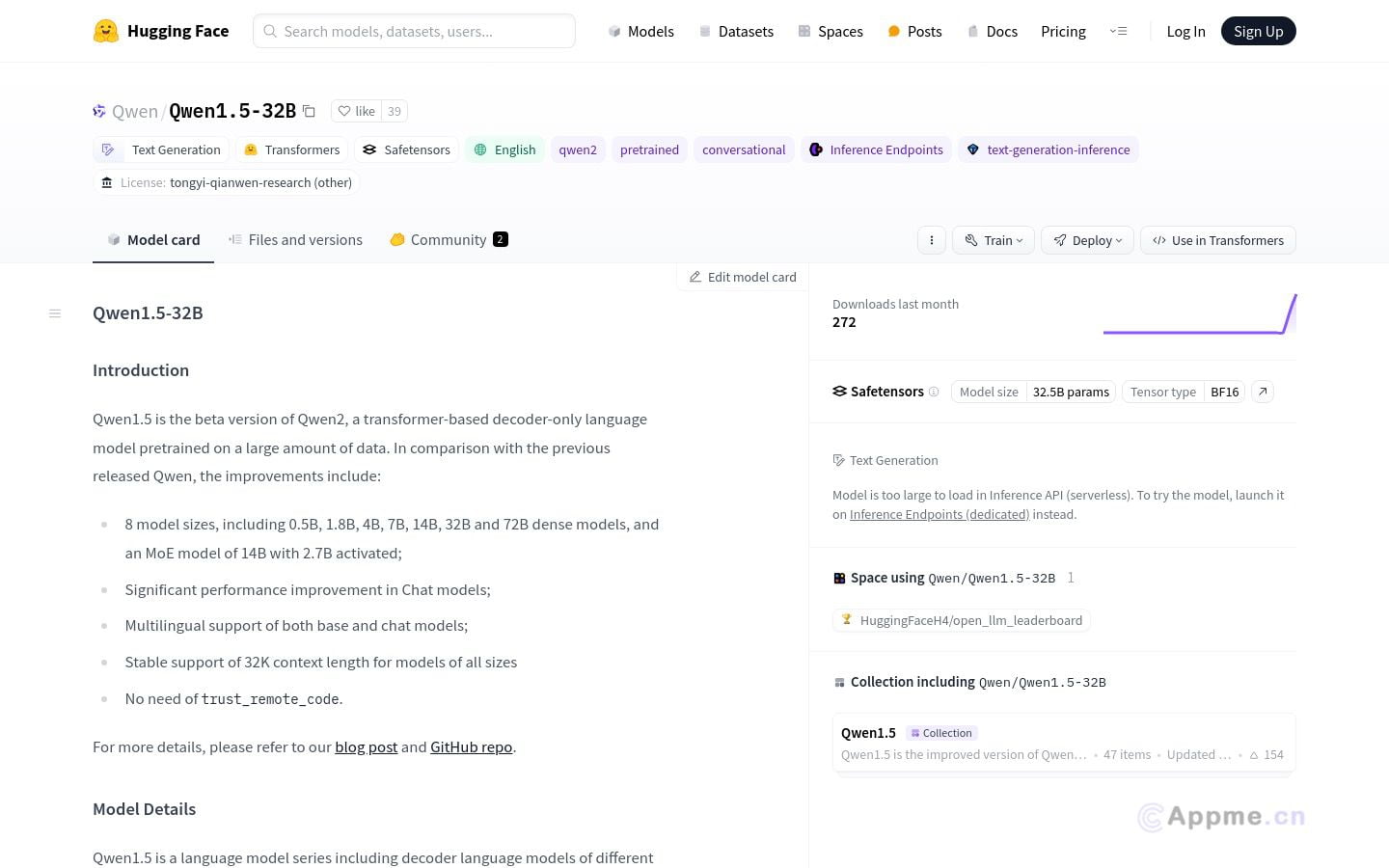

Qwen1.5-32B是一款基于Transformer架构的大规模语言模型,主要用于自然语言处理、文本生成和对话系统等任务。该模型具有多项先进特性,如SwiGLU激活、注意力QKV偏置和组查询注意力等,支持多种自然语言和代码处理。Qwen1.5系列提供了从0.5B到72B不同规模的模型,可满足各种应用需求。其32K上下文长度的稳定支持和显著提升的Chat模型性能,使其在复杂任务中表现出色。

这款免费工具特别适合研究人员、开发团队和学生使用。它为用户提供了强大的语言处理能力,可用于学术研究、产品开发和实验项目。Qwen1.5-32B的多语言支持和代码处理能力,使其成为跨语言应用和编程辅助的理想选择。通过使用此模型,用户可以大幅提升自然语言处理效率,加速项目开发进程,并在人工智能领域获得宝贵的实践经验。